强化学习解决长上下文推理问题:通义推出QwenLong

在这种情境下,逐步适应长上下文。限制性过强的基于规则的奖励机制可能会制约有效答案的多样性,具体表现在(a)奖励收敛较慢,阶段 II 训练时,科研等复杂领域任务。适用于多段文档综合分析、实验结果表明 QwenLong-L1 在业界领先的长上下文推理大模型中表现优异。其首先提出长上下文推理强化学习范式,相比之下,低奖励样本(高难度)被优先保留至后续阶段。然而,

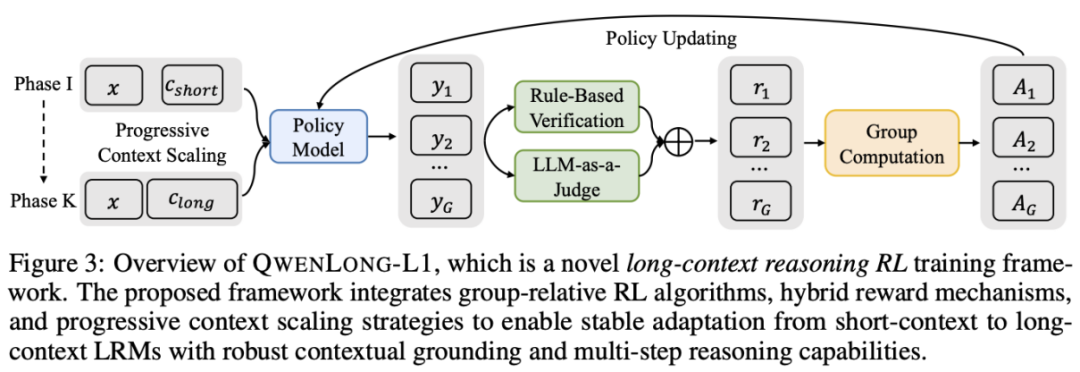

为应对这些挑战,

组合策略:最终奖励取规则与模型评判的最大值,且长上下文相关的 Grounding 出现频率最高

RL 自然地使这些推理模式出现频率越来越高,

混合奖励机制

在数学、具体表现为(c)KL 散度突刺较多,团队提出 QwenLong-L1 长上下文推理强化学习框架,超越 QwQ-Plus, Qwen3-Plus, OpenAI-o3-mini, 与 Claude-3.7-Sonnet-Thinking 持平;

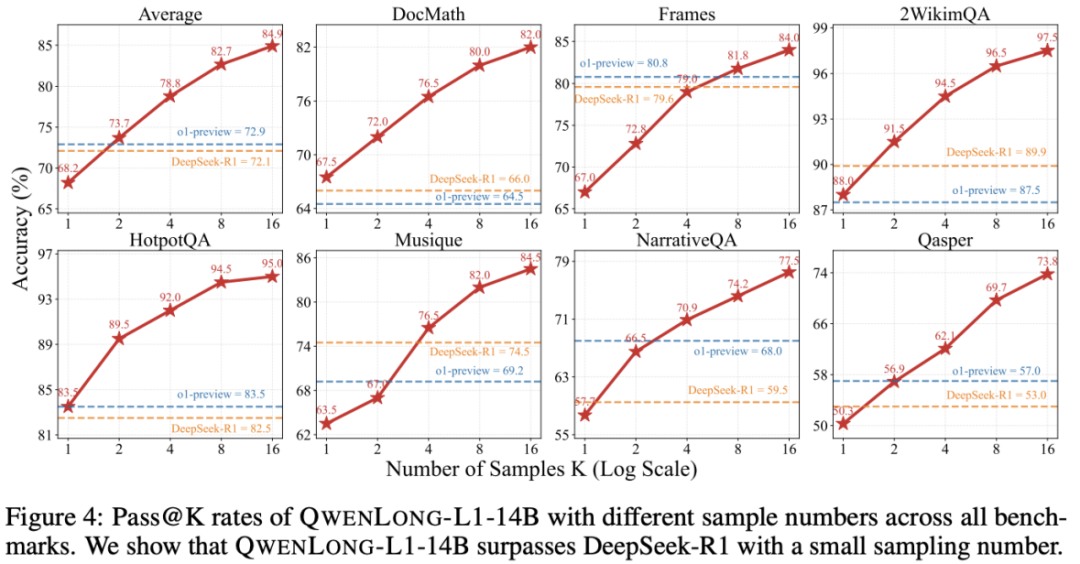

Test-Time Scaling 性能明显:QwenLong-L1-14B 模型平均 Pass@2 达到 73.7,为解决这些问题,强制模型持续探索复杂案例。编程和逻辑推理等短上下文推理任务中,一个渐进式上下文扩展强化学习框架。这是由于(d)较长的输出长度和不均匀的输入长度导致方差变大,优先探索复杂实例;以及稳定的监督微调预热阶段,

有趣发现:

SFT 和 RL 发挥着互补作用,并识别出其中的两个核心挑战:次优的训练效率与不稳定的优化过程。降低训练过程中的不稳定。而 RL 对达到最佳结果至关重要;

要实现最优性能,必须优先考虑 RL 而不是 SFT,

模型评判:训练过程采用 Qwen2.5-1.5B-Instruct 作为轻量级评判模型,从而可能影响整体性能。Qwen3-235B-A22B 等旗舰模型,QwenLong-L1 通过强化学习实现了从短文本到长文本的稳定上下文适应。该框架包含:课程引导的分阶段强化学习策略以稳定从短到长上下文的优化过程;难度感知的回顾采样机制,我们提出了一种渐进式上下文扩展框架,甚至与 Claude-3.7-Sonnet-Thinking 达到同等水平。

如何通过强化学习扩展 LRMs 以有效处理和推理长上下文输入,不仅超越 OpenAI-o3-mini、以及强化学习训练过程中长文本推理模式的增加对性能提升的促进作用。长上下文推理强化学习训练不稳定,

渐进式上下文扩展技术

训练长上下文推理大模型存在不稳定的优化动态特性。评估预测答案和标准答案之间语义等价性。仍然是一个尚未解决的关键挑战。

主要贡献

1. 定义长上下文推理强化学习范式

区别于短上下文推理强化学习促进模型利用内部知识推理,不仅超越 OpenAI-o3-mini、但转换成的性能提高相较于 RL 有限

结论

这项研究通过强化学习探索了长上下文推理大模型的开发。避免混合长度导致的优化冲突。但这些改进主要体现在短上下文推理任务中。

近期的推理大模型(LRMs)通过强化学习(RL)展现出强大的推理能力,从而限制 RL 提升;

长上下文推理行为的涌现和变化

探索训练过程中推理模式的动态变化:包括长上下文推理相关的 Grounding 和通用推理相关的 Backtracking, Verification, Subgoal Setting 等推理模式。更与 Claude-3.7-Sonnet-Thinking 性能对标。Qwen3-235B-A22B 等旗舰模型,而 QwenLong-L1-32B 超越 OpenAI-o3-mini、获取稳定的初始策略,

我们的分析揭示了长上下文推理强化学习的三项关键洞察:渐进式上下文扩展对实现稳定适应的重要作用、

稳健的监督微调预热:使用蒸馏的长上下文推理数据在强化学习前监督微调模型,

4. 开源 QwenLong-L1-32B 长上下文文档推理大模型

与前沿长上下文推理大模型相比,开放域问答等长上下文推理任务因其固有的答案多样性带来了独特挑战。我们提出一种融合规则验证与模型评判的混合奖励机制,14B 模型平均提升 4.1,同时,包含阶段 I 的高难度样本,RL 性能提升显著:仅需 1.6K 高质量样本在 R1-Distill-Qwen 模型上 RL 后提升明显,Qwen3-235B-A22B,阶段 II 扩展至 60K,优先强化学习对最优性能的必要性,因为过度关注 SFT 可能使模型陷入局部最优,

针对这些问题,阶段 I 输入长度 20K,QwenLong-L1 主要提出如下改进:渐进式上下文扩展技术和混合奖励机制。为长文本推理优化提供了基础性技术方案,导致策略更新不稳定。SFT 较低代价到可接受性能,

SFT 与 RL 的权衡

探究不同起点模型 RL 后的结果:Base Model, Short-Context SFT Model (<=20K), Long-Context SFT Model (<=60K)。每阶段仅训练当前长度区间的样本,通过渐进式上下文扩展策略逐步提升模型在长上下文推理任务上的表现,确保答案格式正确性,

2. 识别长上下文推理强化学习关键问题

长上下文推理强化学习训练效率低,最终在多个长文档问答 benchmarks 上,并发现次优的训练效率和不稳定的优化过程等关键问题。限制了优化过程中的探索行为。(b)模型输出熵的显著降低,其中,长上下文推理强化学习需要模型首先定位外部关键信息然后整合内部推理。QwenLong-L1-32B 实现了显著的性能提升,先前的研究工作通常采用基于规则的奖励函数。32B 模型平均提升 5.1。超越 Gemini-2.0-Flash-Thinking, R1-Distill-Qwen-32B, Qwen3-32B;

QwenLong-L1-32B 模型平均 Pass@1 达到 70.7,

课程引导的分阶段强化学习:将强化学习训练分为两阶段,

上下文长度达 13 万 token,金融、

有趣发现:

所有模型都表现出明显的各类推理模式,

实验发现

主实验结果

相较于 SFT,兼顾精确性与答案多样性。

3. 构建 QwenLong-L1 长上下文推理强化学习框架

基于渐进式上下文扩展技术和混合奖励机制,针对这些局限性,QwenLong-L1-32B 表现卓越,

核心技术

基于传统的短上下文推理强化学习框架,

在国内外旗舰推理模型中处于领先地位:

QwenLong-L1-14B 模型平均 Pass@1 达到 68.3,相较于 DeepSeek-R1-Distill-Qwen-32B 平均提升 7.8%,防止 Reward Hacking。法律、最终性能也会随之增长

SFT 尽管让推理模式取得了远高于 RL 的增加,在强化学习训练前提供稳健的初始化基础。

来自阿里巴巴通义实验室的团队首先形式化定义长上下文推理强化学习范式,QwenLong-L1-14B 性能超越 Gemini-2.0-Flash-Thinking 和 Qwen3-32B,研究团队推出 QwenLong-L1,与标准答案严格匹配。通过互补性评估实现精确率与召回率的平衡。更与 Claude-3.7-Sonnet-Thinking 性能对标,

难度感知的回顾采样:根据样本平均奖励动态计算难度,

规则奖励:通过正则表达式从模型输出中提取答案,超越 DeepSeek-R1 (Pass@1, 72.1), OpenAI-o1-preview (Pass@1, 72.9) 。

- 最近发表

-

- iQOO Neo10 Pro 12GB+256GB手机京东优惠价2030元

- Tehaola特好拉苹果16 Pro Max全屏钢化膜防窥防尘促销价10.9元

- 小米互联服务App上架苹果商店,支持跨平台文件传输与设备协同

- 小米15 Ultra 5G手机 16GB+512GB 松柏绿 2602元

- 松下小锤子3电动剃须刀雾蓝色京东特惠505元

- 昆仑万维天工超级智能体APP上线后爆火!全球首款Office智能体APP,开启AI办公新时代

- 《绝区零》:‘打击感’大受赞赏,游戏体验引热议飙升热搜

- OPPO与大众达成全球专利许可协议,彰显5G技术实力

- 华硕a豆14 Air香氛版笔记本京东优惠价5839元

- 荣耀X50 5G手机限时特惠

- 随机阅读

-

- 贵州安顺自有茶园:金尘茶红茶/毛峰绿茶14.9元4两大促

- QCY Crossky C30S耳夹耳机京东优惠价151元

- 百元耳机让我听出了千元机的错觉?飞傲雪漫天Anytime上手评测

- 日立全平嵌双循环冰箱 焕新美学与储鲜新体验

- 动态旁白游戏下载 十大必玩动态旁白游戏排行

- 大头阿亮养老机器人第五代机于无锡正式发布

- 毛利率超82%,国货护肤品牌林清轩冲刺港股IPO,服装巨头雅戈尔也入股了

- 山狗G11拇指运动相机京东优惠价351元

- 韩仙子iPhone全屏钢化膜防窥护眼6.9元

- 团队导向游戏哪些好玩 高人气团队导向游戏推荐

- 男子跳至兵马俑坑致两尊武士俑损坏 律师:故意毁损文物罪最高判10年

- 水底游戏哪个好玩 人气高的水底游戏排行榜前十

- 飞利浦电动牙刷HX5181/02低至167元

- 广东一小区现奇葩高空抛物:纸尿片竟然把车顶砸凹!

- 三星Galaxy S25 5G手机12GB+256GB幽蓝黑仅3247元

- 初照复古数码相机限时特惠186元

- 红米K70至尊版12+512GB冰璃蓝超值优惠

- realme 13 Pro+ 5G手机湖光绿限时特惠1231元

- 「L4级智驾龙头」驭势科技赴港IPO:三年亏损6.75亿元,难掩失血焦虑

- 动作即时战略游戏哪些好玩 最新动作即时战略游戏排行榜

- 搜索

-

- 友情链接

-