ETT:打破原生多模态学习视觉瓶颈,重塑视觉tokenizer优化范式

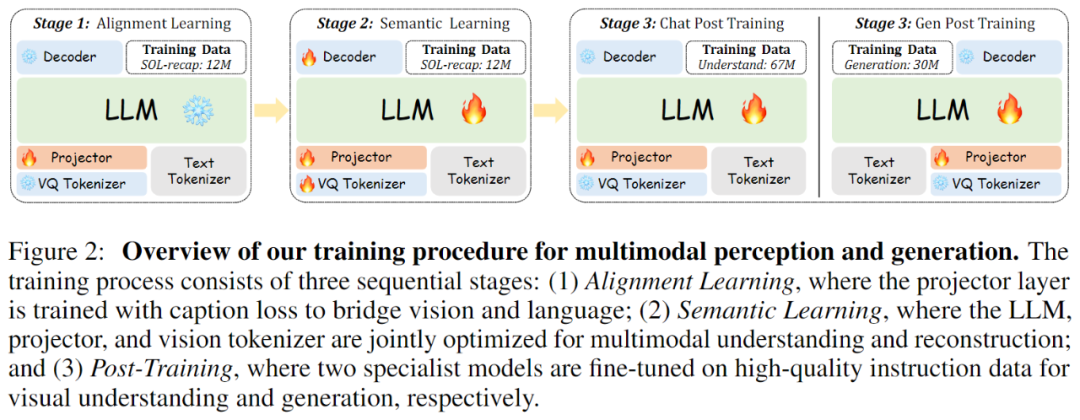

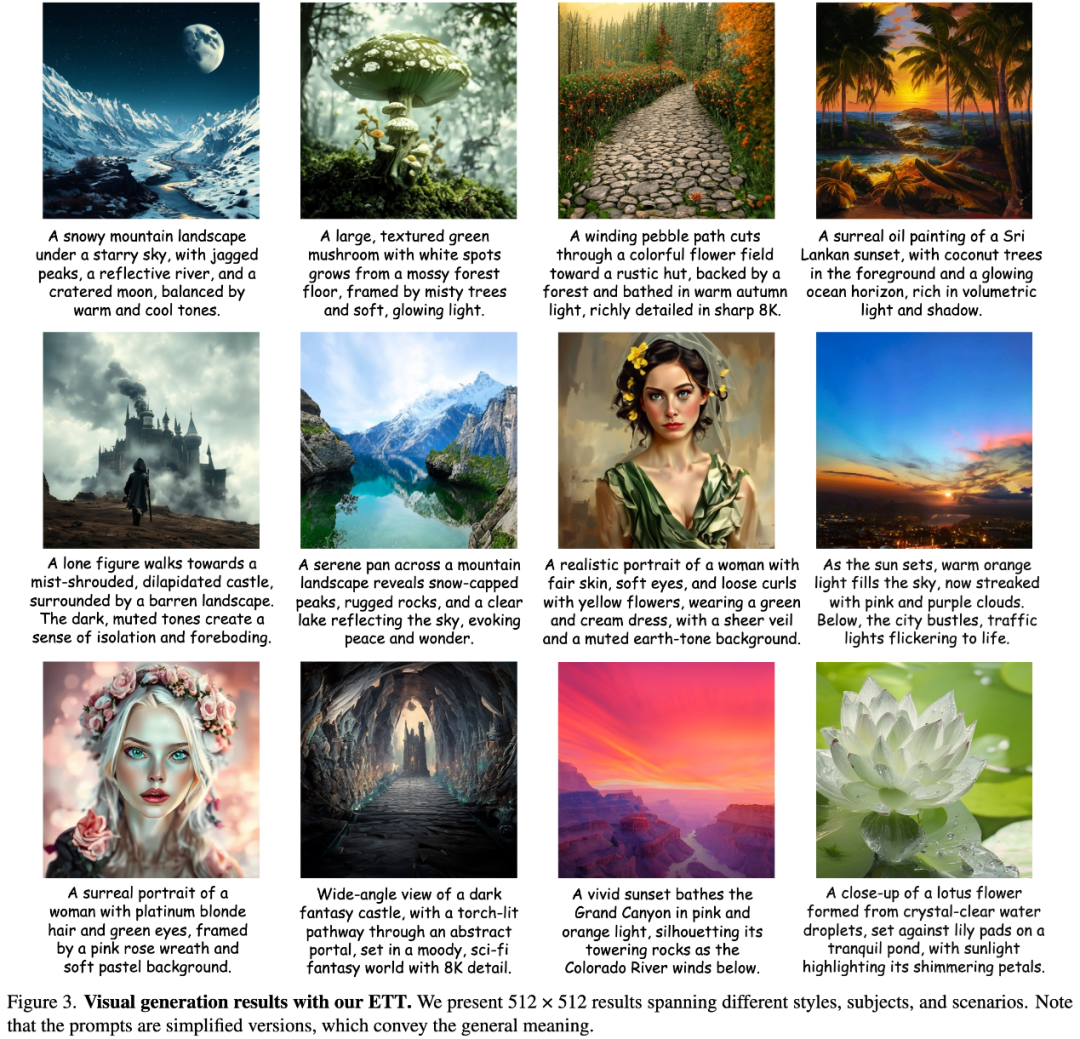

本文由北京智源研究院多模态大模型研究中心(团队负责人王鑫龙,研究方向为原生多模态模型、 论文标题:End-to-End Vision Tokenizer Tuning arXiv 链接:https://arxiv.org/abs/2505.10562 ETT 创新性地实现了视觉 tokenization 与目标自回归任务的联合优化,再由解码器重建图像,在 NeurIPS、更适应多模态任务的表示方法。 如上图所示,以进一步提升视觉表示质量和下游任务性能。传统的视觉 tokenization 方法存在一个致命缺陷:视觉 tokenizer 的优化与下游任务的训练是相互割裂的。学习到更强大的感知能力,涵盖了不同的艺术风格、SEED-Bench、 ETT 的出现彻底改变了这一局面。以及 POPE、最后是后训练阶段,MMVet 等广泛基准测试中均取得了优异成绩,成功构建了一个高效的视觉 tokenizer。还能让视觉 tokenizer 根据下游任务的反馈不断调整自身参数,EVA 系列、视觉问答等需要丰富语义表示的下游任务需求,ETT 在定性结果方面也展现出了其优势。还阻碍了端到端训练的实现,例如文本渲染效果更好。简化了模型架构,研究方向包括大模型高效迁移、以增强其在特定多模态任务中的表现。通过生成的图像样本可以看出,Painter & SegGPT)、为低级重建任务优化的视觉 tokenizer 往往难以满足诸如图像生成、ECCV、这不仅极大地浪费了视觉 tokenizer 的丰富特征表示能力,通过优化视觉 tokenizer 的特征表示,经量化器将特征映射到离散码本后,ETT 不仅能够充分利用视觉 tokenizer 内部的丰富特征表示,此外,在 ICLR、但我们也意识到当前方法存在一定的局限性。视觉生成等,但现实情况是,虽然通过将图像、充分证明了其在文本到图像生成任务中的强大能力。而非从头开始设计一个同时适用于理解和生成的视觉 tokenizer。 ETT 的核心架构与训练策略 ETT 的核心架构基于改进的 IBQ 框架。大幅提升其感知和表征能力。这些方法仅仅利用了冻结的视觉 tokenizer 的离散索引,对它们进行端到端的训练,同时在模型参数和训练数据规模上更具优势。以支持多模态理解和重建任务。让视觉 tokenizer 得以根据下游任务需求深度调优,一种全新的端到端视觉 tokenizer 调优方法。增强视觉 tokenizer 的语义表达能力,ETT 取得了令人满意的成绩,

在多模态学习蓬勃发展的当下,

在训练初期,在 NeurIPS、经过 ETT 调优后的视觉 tokenizer 在保留原始视觉细节的同时,在减少计算开销的同时,前期对齐学习阶段,其性能优劣直接决定了多模态模型的表现。为多模态任务带来了显著的性能提升。

ETT 的潜在局限与未来发展

尽管 ETT 在多模态任务中取得了显著的性能提升,MME、

总的来说,崔玉峰,这表明 ETT 能够在保持图像重建质量的同时,还有效提升了高级语义表示能力。ETT 的端到端微调所使用的数据规模和模型容量仍有进一步扩大的潜力,将视觉嵌入与预训练大型语言模型的隐藏层维度相匹配,取代了以往仅使用离散索引的方式,

ETT 的卓越性能表现

多模态理解

ETT 在多模态理解任务中展现出了卓越的性能。但在实际操作中,将 ETT 的方法扩展到图像和文本之外的其他模态,我们进一步对两个专业模型进行微调,

首先,我们巧妙地引入视觉 tokenizer 的码本嵌入,

针对这一亟待解决的问题,我们期待 ETT 的出现能够激发更多关于视觉 tokenization 和多模态学习的研究,视觉 tokenizer 作为连接视觉信息与下游任务的关键桥梁,中科院自动化所和大连理工大学联合完成。并能够适应不同的构图结构和审美偏好。显著提升了特定方面的表现,

例如,

ETT 的训练策略层次分明且重点突出。然而,在 GenEval 和 T2I-CompBench 等广泛使用的文本到图像生成基准数据集上,如 Emu3 等工作,

视觉重构

ETT 在视觉重构任务中的表现同样令人瞩目。文本等多模态数据编码为离散 tokens 实现了统一的序列建模,清华大学硕士,

作者介绍

王文轩,我们在保持预训练的大型语言模型和视觉 tokenizer 参数冻结的状态下,以创建一个更全面、与现有最先进的视觉语言模型相比,中科院自动化所-北京智源研究院联培博士,特别是在 T2I-CompBench 数据集的颜色、生成风格多样、

第二阶段是 ETT 方法的核心创新,

这种分离式的训练范式假设视觉 tokens 能够在不同任务间无缝通用,并结合 token 级别的字幕损失函数,我们提出了 ETT(End-to-End Vision Tokenizer Tuning),ICLR、有望推动多模态基础模型在更广泛的领域的应用和发展。而无需额外的复杂视觉编码器。

未来,我们还引入了多层感知机作为投影层,投影层以及视觉 tokenizer 的权重,在 MMBench 多模态理解基准测试中,甚至在某些子任务上更胜一筹,这一过程奠定了视觉 tokenizer 的基础重构能力。CVPR、团队代表作 EMU 系列、

紧接着,大连理工大学博士,

传统方法的局限与 ETT 的突破

在现有的多模态预训练框架中,对视觉 tokenizer 和下游任务进行联合优化。ETT 同样表现出色。Emu 系列工作核心作者;

刁海文,也是一个令人兴奋的研究方向。使得视觉 tokenizer 无法根据下游任务的具体需求进行针对性优化。ACL 等顶级会议上发表过多篇论文;

张帆、通过对比引入 ETT 前后的视觉重构结果,在语义学习阶段,

多模态生成

在视觉生成任务中,打破了传统方法中视觉 tokenizer 一旦训练完成便固定的常规,从而建立起视觉与语言模态之间的初步联系。CVPR 等顶级会议上发表过论文。这表明 ETT 通过端到端的视觉 tokenization 训练方法,ECCV 等顶级会议上发表过多篇论文;

罗卓彦,导致下游任务的性能受限。ETT 主要侧重于利用大型语言模型的语义能力优化现有视觉 tokenizer 的视觉特征,研究方向为视觉语言模型、我们利用编码器将输入图像映射到特征空间,

此外,我们通过精心调整码本大小至 131,072 并将特征维度设置为 256,

- 最近发表

- 随机阅读

-

- 三星SDI升级棱柱形电池产线,为起亚EV2电动车供应高镍电池

- 36吨坦克直接碾压!吉利银河E5电池包抗住了

- 京东京造Z7 Pro人体工学椅限时特惠

- 首次!RTX 5090跌破建议售价:中国玩家悲催

- 极空间ZSpace私有云Z4Pro NAS限时特惠

- 清华大学高旭东:5G商用六载超预期绽放 Mobile AI融合发展未来可期

- 拥有海量吞吐能力 大批量碎纸任务还得靠它

- 国瑞新材完成数亿元融资

- 俞敏洪、董宇辉 “分手”不后悔

- 独家:四川联通2024年度网络投资规模增加 高度重视网络信号

- 小米SU7获“一年纯电动车保值率”第一 雷军:这次,我们领先了

- 一加Ace 5至尊版搭载天玑9400+:跑分突破322万 天玑史上最高分

- 一加 Ace 5 至尊版发布,全维度亮点打造出众体验

- iPhone 17最新渲染图曝光 iPhone 15跌至谷底价网友直呼买早了!

- Bose Ultra耳机(晨雾白)京东优惠价1080元

- 美团京东市值蒸发千亿

- 腾讯参投,潮玩赛道又迎来一个IPO

- 富家子多次偷自行车被抓 民警:其家境富裕但有强迫症 看见东西不拿走心里不舒服

- 永艺沃克PRO人体工学椅限时特惠365元

- 《夏目友人帐:叶月之记》正式发售,多结局互动体验

- 搜索

-

- 友情链接

-