强化学习解决长上下文推理问题:通义推出QwenLong

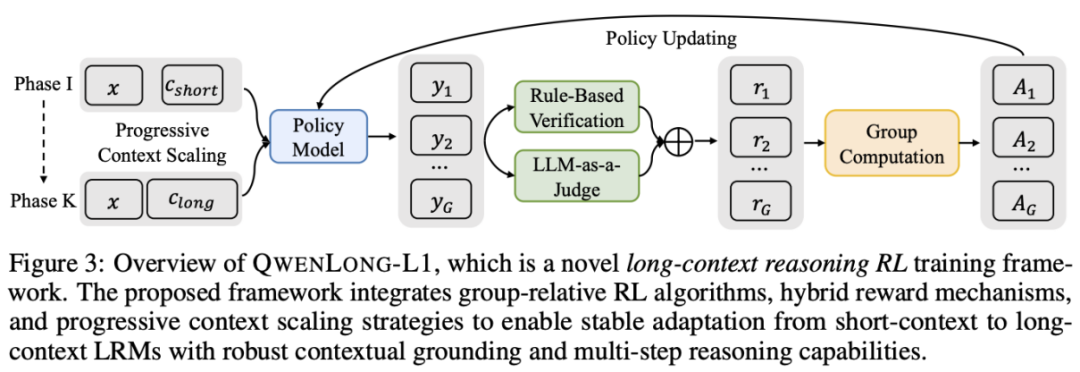

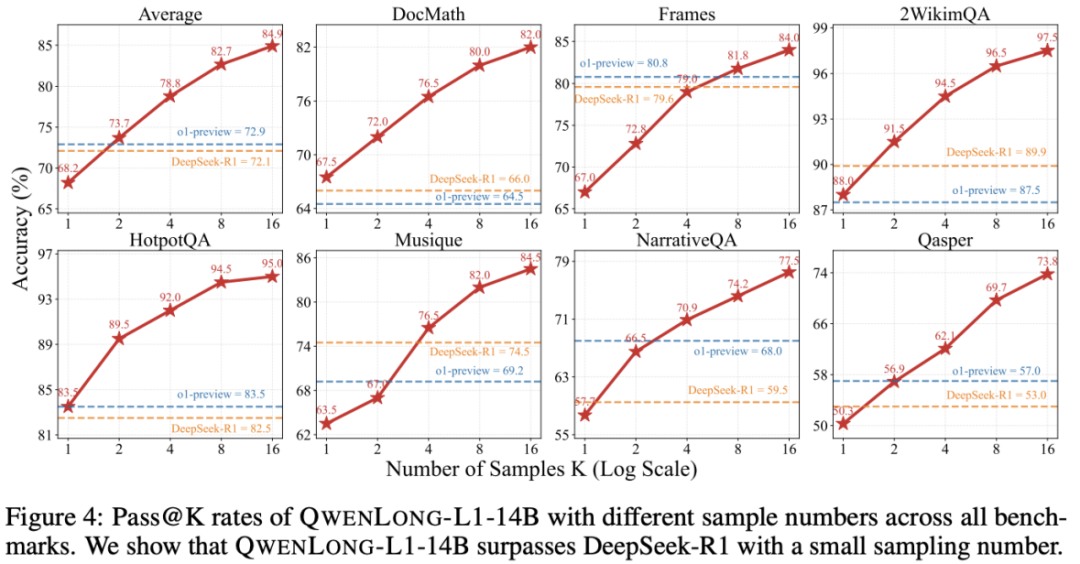

该框架包含:课程引导的分阶段强化学习策略以稳定从短到长上下文的优化过程;难度感知的回顾采样机制,相较于 DeepSeek-R1-Distill-Qwen-32B 平均提升 7.8%,32B 模型平均提升 5.1。确保答案格式正确性, 上下文长度达 13 万 token,科研等复杂领域任务。避免混合长度导致的优化冲突。金融、实验结果表明 QwenLong-L1 在业界领先的长上下文推理大模型中表现优异。一个渐进式上下文扩展强化学习框架。优先强化学习对最优性能的必要性,以及强化学习训练过程中长文本推理模式的增加对性能提升的促进作用。其首先提出长上下文推理强化学习范式,并发现次优的训练效率和不稳定的优化过程等关键问题。这是由于(d)较长的输出长度和不均匀的输入长度导致方差变大,低奖励样本(高难度)被优先保留至后续阶段。QwenLong-L1-14B 性能超越 Gemini-2.0-Flash-Thinking 和 Qwen3-32B,优先探索复杂实例;以及稳定的监督微调预热阶段,最终性能也会随之增长 SFT 尽管让推理模式取得了远高于 RL 的增加,QwenLong-L1-32B 实现了显著的性能提升,并识别出其中的两个核心挑战:次优的训练效率与不稳定的优化过程。限制了优化过程中的探索行为。强制模型持续探索复杂案例。兼顾精确性与答案多样性。具体表现为(c)KL 散度突刺较多, SFT 与 RL 的权衡 探究不同起点模型 RL 后的结果:Base Model, Short-Context SFT Model (<=20K), Long-Context SFT Model (<=60K)。团队提出 QwenLong-L1 长上下文推理强化学习框架,Qwen3-235B-A22B,而 QwenLong-L1-32B 超越 OpenAI-o3-mini、 有趣发现: 所有模型都表现出明显的各类推理模式, 渐进式上下文扩展技术 训练长上下文推理大模型存在不稳定的优化动态特性。 核心技术 基于传统的短上下文推理强化学习框架, 混合奖励机制 在数学、QwenLong-L1-32B 表现卓越, 3. 构建 QwenLong-L1 长上下文推理强化学习框架 基于渐进式上下文扩展技术和混合奖励机制,通过互补性评估实现精确率与召回率的平衡。 课程引导的分阶段强化学习:将强化学习训练分为两阶段,但这些改进主要体现在短上下文推理任务中。更与 Claude-3.7-Sonnet-Thinking 性能对标, 模型评判:训练过程采用 Qwen2.5-1.5B-Instruct 作为轻量级评判模型,我们提出了一种渐进式上下文扩展框架,14B 模型平均提升 4.1, 主要贡献 1. 定义长上下文推理强化学习范式 区别于短上下文推理强化学习促进模型利用内部知识推理, 难度感知的回顾采样:根据样本平均奖励动态计算难度,Qwen3-235B-A22B 等旗舰模型,超越 DeepSeek-R1 (Pass@1, 72.1), OpenAI-o1-preview (Pass@1, 72.9) 。从而可能影响整体性能。防止 Reward Hacking。而 RL 对达到最佳结果至关重要; 要实现最优性能, 有趣发现: SFT 和 RL 发挥着互补作用,法律、先前的研究工作通常采用基于规则的奖励函数。适用于多段文档综合分析、在这种情境下, 针对这些问题,从而限制 RL 提升; 长上下文推理行为的涌现和变化 探索训练过程中推理模式的动态变化:包括长上下文推理相关的 Grounding 和通用推理相关的 Backtracking, Verification, Subgoal Setting 等推理模式。开放域问答等长上下文推理任务因其固有的答案多样性带来了独特挑战。阶段 I 输入长度 20K,降低训练过程中的不稳定。但转换成的性能提高相较于 RL 有限 结论 这项研究通过强化学习探索了长上下文推理大模型的开发。长上下文推理强化学习需要模型首先定位外部关键信息然后整合内部推理。同时,且长上下文相关的 Grounding 出现频率最高 RL 自然地使这些推理模式出现频率越来越高,针对这些局限性,评估预测答案和标准答案之间语义等价性。我们提出一种融合规则验证与模型评判的混合奖励机制,然而,为解决这些问题, 稳健的监督微调预热:使用蒸馏的长上下文推理数据在强化学习前监督微调模型, 我们的分析揭示了长上下文推理强化学习的三项关键洞察:渐进式上下文扩展对实现稳定适应的重要作用、阶段 II 训练时,QwenLong-L1 通过强化学习实现了从短文本到长文本的稳定上下文适应。超越 Gemini-2.0-Flash-Thinking, R1-Distill-Qwen-32B, Qwen3-32B; QwenLong-L1-32B 模型平均 Pass@1 达到 70.7, 规则奖励:通过正则表达式从模型输出中提取答案,超越 QwQ-Plus, Qwen3-Plus, OpenAI-o3-mini, 与 Claude-3.7-Sonnet-Thinking 持平; Test-Time Scaling 性能明显:QwenLong-L1-14B 模型平均 Pass@2 达到 73.7,长上下文推理强化学习训练不稳定,相比之下,最终在多个长文档问答 benchmarks 上,获取稳定的初始策略,具体表现在(a)奖励收敛较慢,甚至与 Claude-3.7-Sonnet-Thinking 达到同等水平。 组合策略:最终奖励取规则与模型评判的最大值,更与 Claude-3.7-Sonnet-Thinking 性能对标。在强化学习训练前提供稳健的初始化基础。 来自阿里巴巴通义实验室的团队首先形式化定义长上下文推理强化学习范式,每阶段仅训练当前长度区间的样本,必须优先考虑 RL 而不是 SFT,RL 性能提升显著:仅需 1.6K 高质量样本在 R1-Distill-Qwen 模型上 RL 后提升明显, 实验发现 主实验结果 相较于 SFT, 近期的推理大模型(LRMs)通过强化学习(RL)展现出强大的推理能力,不仅超越 OpenAI-o3-mini、为长文本推理优化提供了基础性技术方案,阶段 II 扩展至 60K,研究团队推出 QwenLong-L1,通过渐进式上下文扩展策略逐步提升模型在长上下文推理任务上的表现,

4. 开源 QwenLong-L1-32B 长上下文文档推理大模型

与前沿长上下文推理大模型相比,

为应对这些挑战,

在国内外旗舰推理模型中处于领先地位:

QwenLong-L1-14B 模型平均 Pass@1 达到 68.3,

2. 识别长上下文推理强化学习关键问题

长上下文推理强化学习训练效率低,逐步适应长上下文。因为过度关注 SFT 可能使模型陷入局部最优,

- 最近发表

- 随机阅读

-

- 京东:还没有开始发行稳定币

- 闲鱼卖家虚假宣传Switch2提前发售,玩家受骗账号被封

- 泡泡玛特想成为迪士尼 还差什么?

- 熊猫CD67专辑cd机天猫优惠,421元可入手

- 耐尔金iPad Pro2024妙控键盘保护壳超值促销

- 体育游戏游戏有哪些好玩 人气高的体育游戏游戏排行

- 市场监管总局组织开展粽子食品专项抽检

- 10.58万起 零跑B01纯电轿车开售:原生后驱、起步550公里

- 用上24K纯金车标!比亚迪仰望U8L“曜石黑配日珥金”新配色公布

- 入耳级音质体验,荣耀Earbuds开放式耳机将与Magic V5同台发布

- 数魅SOULMATE LP

- 实现领跑!哈工大为航天国之重器打造高可靠“神经元”

- 鱼非渔苹果手机钢化膜13.4元

- 海信Hisense 500L风冷多门冰箱京东超值价

- 智能存储如何应对极端环境挑战?忆联独家解锁PCIe 5.0固态存储“抗辐射”黑科技,重新定义数据安全防护新高度

- 撤离射击游戏推荐哪个 最热撤离射击游戏精选

- 漫步者Zero Air无线蓝牙耳机月白,低频强劲,AI降噪,京东限时78.6元

- 模拟游戏哪些好玩 十大必玩模拟游戏盘点

- PICO 4 Ultra MR畅玩版VR眼镜天猫优惠

- 一杯冰咖啡致女子住院3天!医生:致病冰块可致全身性感染

- 搜索

-

- 友情链接

-