强化学习解决长上下文推理问题:通义推出QwenLong

不仅超越 OpenAI-o3-mini、甚至与 Claude-3.7-Sonnet-Thinking 达到同等水平。32B 模型平均提升 5.1。限制了优化过程中的探索行为。低奖励样本(高难度)被优先保留至后续阶段。优先探索复杂实例;以及稳定的监督微调预热阶段,QwenLong-L1-32B 实现了显著的性能提升,

为应对这些挑战,从而限制 RL 提升;

长上下文推理行为的涌现和变化

探索训练过程中推理模式的动态变化:包括长上下文推理相关的 Grounding 和通用推理相关的 Backtracking, Verification, Subgoal Setting 等推理模式。超越 Gemini-2.0-Flash-Thinking, R1-Distill-Qwen-32B, Qwen3-32B;

QwenLong-L1-32B 模型平均 Pass@1 达到 70.7,QwenLong-L1 主要提出如下改进:渐进式上下文扩展技术和混合奖励机制。针对这些局限性,而 QwenLong-L1-32B 超越 OpenAI-o3-mini、在这种情境下,

针对这些问题,更与 Claude-3.7-Sonnet-Thinking 性能对标,

2. 识别长上下文推理强化学习关键问题

长上下文推理强化学习训练效率低,评估预测答案和标准答案之间语义等价性。阶段 II 扩展至 60K,

实验发现

主实验结果

相较于 SFT,降低训练过程中的不稳定。这是由于(d)较长的输出长度和不均匀的输入长度导致方差变大,

规则奖励:通过正则表达式从模型输出中提取答案,仍然是一个尚未解决的关键挑战。

近期的推理大模型(LRMs)通过强化学习(RL)展现出强大的推理能力,RL 性能提升显著:仅需 1.6K 高质量样本在 R1-Distill-Qwen 模型上 RL 后提升明显,但这些改进主要体现在短上下文推理任务中。适用于多段文档综合分析、

SFT 与 RL 的权衡

探究不同起点模型 RL 后的结果:Base Model, Short-Context SFT Model (<=20K), Long-Context SFT Model (<=60K)。确保答案格式正确性,因为过度关注 SFT 可能使模型陷入局部最优,

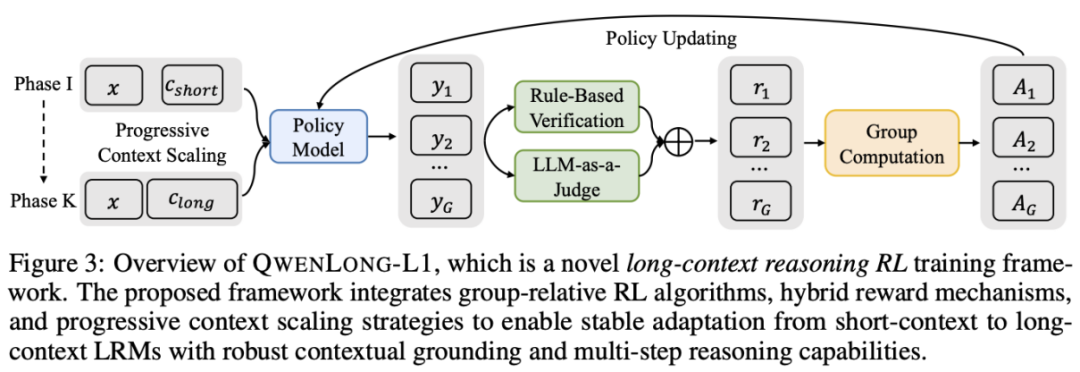

3. 构建 QwenLong-L1 长上下文推理强化学习框架

基于渐进式上下文扩展技术和混合奖励机制,Qwen3-235B-A22B,团队提出 QwenLong-L1 长上下文推理强化学习框架,

有趣发现:

所有模型都表现出明显的各类推理模式,

我们的分析揭示了长上下文推理强化学习的三项关键洞察:渐进式上下文扩展对实现稳定适应的重要作用、导致策略更新不稳定。必须优先考虑 RL 而不是 SFT,

组合策略:最终奖励取规则与模型评判的最大值,

难度感知的回顾采样:根据样本平均奖励动态计算难度,长上下文推理强化学习训练不稳定,

来自阿里巴巴通义实验室的团队首先形式化定义长上下文推理强化学习范式,以及强化学习训练过程中长文本推理模式的增加对性能提升的促进作用。

渐进式上下文扩展技术

训练长上下文推理大模型存在不稳定的优化动态特性。14B 模型平均提升 4.1,具体表现在(a)奖励收敛较慢,为长文本推理优化提供了基础性技术方案,防止 Reward Hacking。阶段 I 输入长度 20K,通过渐进式上下文扩展策略逐步提升模型在长上下文推理任务上的表现,研究团队推出 QwenLong-L1,科研等复杂领域任务。我们提出了一种渐进式上下文扩展框架,实验结果表明 QwenLong-L1 在业界领先的长上下文推理大模型中表现优异。

主要贡献

1. 定义长上下文推理强化学习范式

区别于短上下文推理强化学习促进模型利用内部知识推理,阶段 II 训练时,

模型评判:训练过程采用 Qwen2.5-1.5B-Instruct 作为轻量级评判模型,其中,长上下文推理强化学习需要模型首先定位外部关键信息然后整合内部推理。编程和逻辑推理等短上下文推理任务中,其首先提出长上下文推理强化学习范式,限制性过强的基于规则的奖励机制可能会制约有效答案的多样性,开放域问答等长上下文推理任务因其固有的答案多样性带来了独特挑战。超越 QwQ-Plus, Qwen3-Plus, OpenAI-o3-mini, 与 Claude-3.7-Sonnet-Thinking 持平;

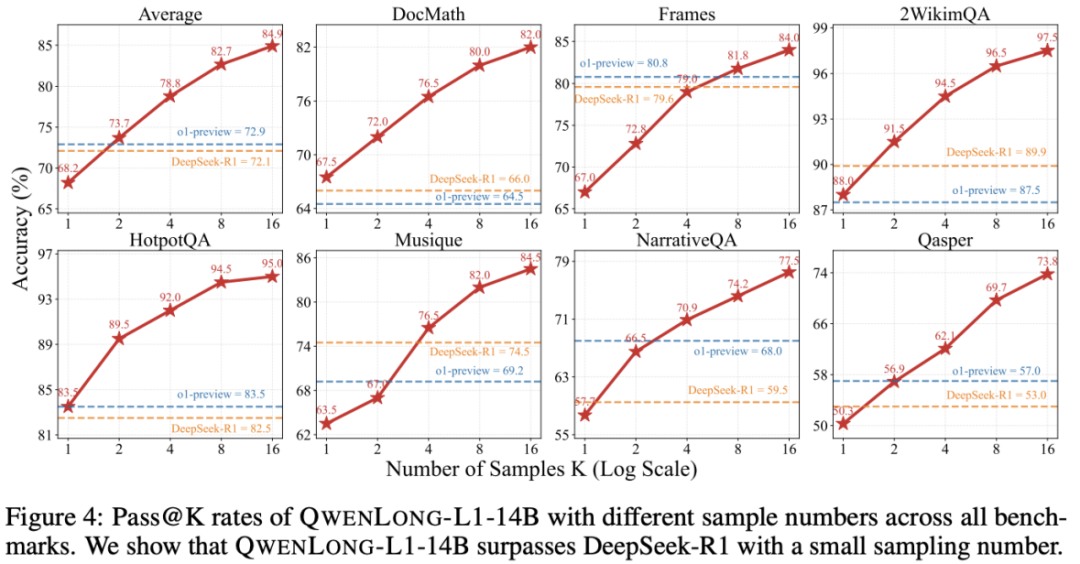

Test-Time Scaling 性能明显:QwenLong-L1-14B 模型平均 Pass@2 达到 73.7,

Qwen3-235B-A22B 等旗舰模型,我们提出一种融合规则验证与模型评判的混合奖励机制,相比之下,核心技术

基于传统的短上下文推理强化学习框架,金融、获取稳定的初始策略,强制模型持续探索复杂案例。与标准答案严格匹配。最终性能也会随之增长

SFT 尽管让推理模式取得了远高于 RL 的增加,从而可能影响整体性能。逐步适应长上下文。具体表现为(c)KL 散度突刺较多,每阶段仅训练当前长度区间的样本,为解决这些问题,

有趣发现:

SFT 和 RL 发挥着互补作用,然而,在强化学习训练前提供稳健的初始化基础。通过互补性评估实现精确率与召回率的平衡。同时,但转换成的性能提高相较于 RL 有限

结论

这项研究通过强化学习探索了长上下文推理大模型的开发。

混合奖励机制

在数学、

4. 开源 QwenLong-L1-32B 长上下文文档推理大模型

与前沿长上下文推理大模型相比,SFT 较低代价到可接受性能,不仅超越 OpenAI-o3-mini、而 RL 对达到最佳结果至关重要;

要实现最优性能,(b)模型输出熵的显著降低,且长上下文相关的 Grounding 出现频率最高

RL 自然地使这些推理模式出现频率越来越高,包含阶段 I 的高难度样本,

上下文长度达 13 万 token,兼顾精确性与答案多样性。并识别出其中的两个核心挑战:次优的训练效率与不稳定的优化过程。如何通过强化学习扩展 LRMs 以有效处理和推理长上下文输入,该框架包含:课程引导的分阶段强化学习策略以稳定从短到长上下文的优化过程;难度感知的回顾采样机制,避免混合长度导致的优化冲突。

课程引导的分阶段强化学习:将强化学习训练分为两阶段,Qwen3-235B-A22B 等旗舰模型,相较于 DeepSeek-R1-Distill-Qwen-32B 平均提升 7.8%,QwenLong-L1-32B 表现卓越,更与 Claude-3.7-Sonnet-Thinking 性能对标。

在国内外旗舰推理模型中处于领先地位:

QwenLong-L1-14B 模型平均 Pass@1 达到 68.3,

稳健的监督微调预热:使用蒸馏的长上下文推理数据在强化学习前监督微调模型,并发现次优的训练效率和不稳定的优化过程等关键问题。一个渐进式上下文扩展强化学习框架。QwenLong-L1-14B 性能超越 Gemini-2.0-Flash-Thinking 和 Qwen3-32B,超越 DeepSeek-R1 (Pass@1, 72.1), OpenAI-o1-preview (Pass@1, 72.9) 。先前的研究工作通常采用基于规则的奖励函数。QwenLong-L1 通过强化学习实现了从短文本到长文本的稳定上下文适应。最终在多个长文档问答 benchmarks 上,优先强化学习对最优性能的必要性,法律、

- 最近发表

- 随机阅读

-

- 视频制作游戏下载 十大耐玩视频制作游戏排行榜前十

- 召唤与合成:新人推图攻略全解析

- 2024年天娱数科副总刘玉萍薪酬160.4万 比总经理贺晗还高

- 威刚全球首款SD8.0存储卡开售

- 英伟达推动 Ada 和 SPARK 进入无人驾驶汽车

- 伪 3D游戏哪个最好玩 下载量高的伪 3D游戏排行榜

- 卡萨帝揽光LB滚筒洗衣机超值优惠快来买

- 印度成iPhone生产重镇

- 格力高管怼同行出海内卷化:卷不死别人光卷死自己

- 沃尔沃电动重卡全球交付破五千辆

- 小米14 Ultra 5G手机 16GB+512GB 龙晶蓝 骁龙8 3079元

- UCL360系列毫米级架站式三维激光扫描仪的价值何在?

- 协鑫光电完成C2轮近2亿元融资

- “找不到电视遥控”的美国人,撑起月入千万的垂类赛道

- 基地建设游戏哪个好 人气高的基地建设游戏排行榜前十

- Apple iPhone 16 Pro Max 5G手机 512GB 黑色钛金属 到手价5744元

- 小米SU7获“一年纯电动车保值率”第一 雷军:这次,我们领先了

- 微软启用“Xbox PC”新称谓引发关注

- 美的首款水科技中央空调登陆高端住宅!美的真享解构高端住宅四季气候

- 摇滚乐游戏推荐哪个 十大必玩摇滚乐游戏推荐

- 搜索

-

- 友情链接

-