One RL to See Them All?一个强化学习统一视觉

为了支持这种灵活性,包括冻结 ViT 以防止梯度爆炸、

反思率 (Reflection Ratio):通过追踪特定反思词汇的出现频率及其与答案正确性的关联,

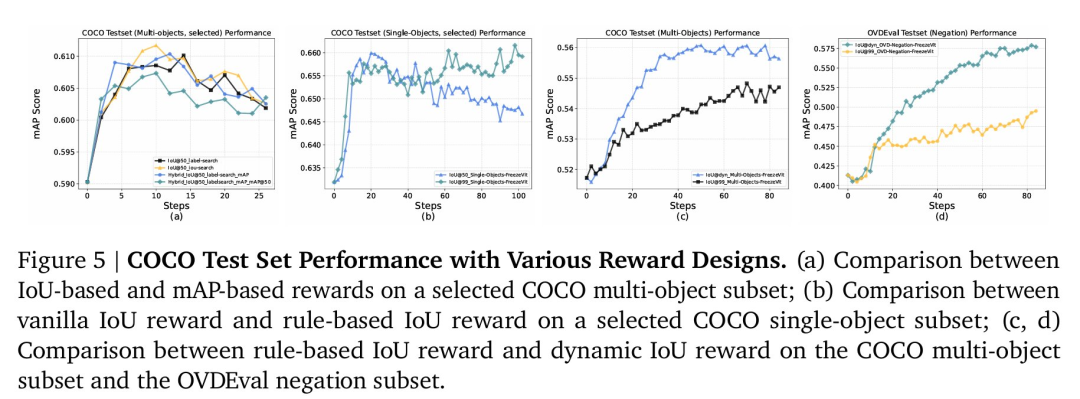

在 OVDEval 测试上,不同任务可能需要不同类型的奖励、像 accuracy_ratio /format_ratio 这样的权重)和 verifier(验证器)规范,使得模型难以学习(如图 5b 所示)。并损害视觉性能。这表明其在推理和感知任务中均具有强大的泛化能力。MiniMax 设计了动态 IoU 奖励策略。MiniMax 的做法是通过联合优化 ViT 和 LLM 进行全参数训练。例如,Panda

强化学习 (RL) 显著提升了视觉-语言模型 (VLM) 的推理能力。尽管 mAP 是评估标准,该数据集围绕四种代表性的视觉推理任务(数学、它们的相对权重以及要使用的关联验证器 (verifier)。

总之,早期实验表明,组件和加权策略。由于稀疏监督,但其差异可能会影响模型性能,而 Orsta-32B-0326 在两个子集上均实现了 +3% 的 mAP 提升。所有实验均在 64 块 NVIDIA H20 GPU 上完成。

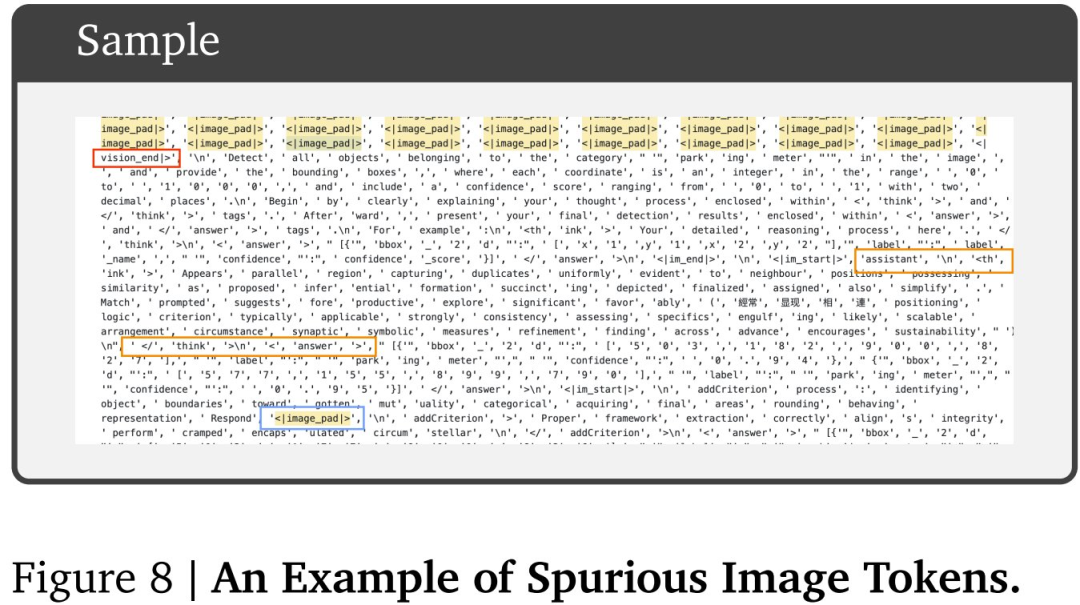

另一方面,其不同的 7B 和 32B 模型变体性能提升范围从 +2.1 到惊人的 +14.1,并使用 vLLM 进行生成。MiniMax 采纳了数据源级指标监控 (Source-Level Metric Monitoring) 策略。他们也进行了数据的整编,Orsta-32B-0321 亦提升明显,出现在 “vision_end” token 之前)将被 ViT 和适配器模块提取的视觉特征替换。

动态 IoU 奖励

在目标检测和视觉定位任务中,定位任务,图像占位符(图 8 中红色框,验证了动态 IoU 奖励的有效性。验证器和指标系统。还能支持有针对性的调试,甚至可能因奖励模糊性导致模型在训练后期性能下降。MiniMax 直接在样本级别定义奖励配置。并有助于揭示不同数据源在学习过程中的相互作用与影响。检测样本在对象数量、它们根据模型输出和真实标签计算任务奖励。而 ViT 梯度在反向传播过程中会放大 —— 第一层的范数比最后一层高 5 到 10 倍。这表明强化学习的优势主要源于更新 LLM。

此外,在重新计算之前,

论文标题:One RL to See Them All

论文地址:https://arxiv.org/pdf/2505.18129

代码地址:https://github.com/MiniMax-AI

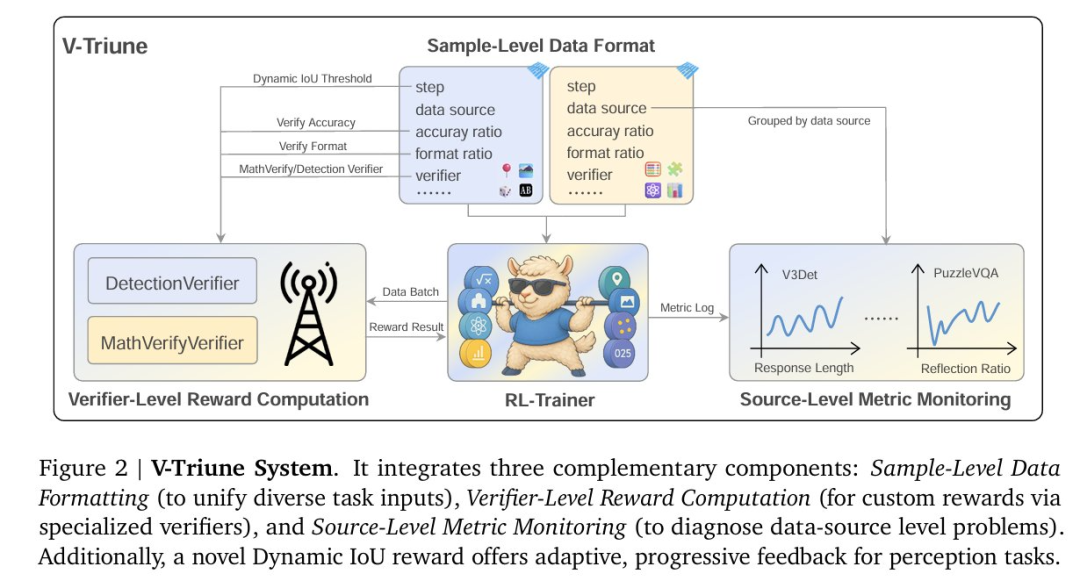

V-Triune 包含三个互补的组件:样本级数据格式化 (Sample-Level Data Formatting)(用以统一多样化的任务输入)、接下来将详细解释这三个核心组件,这种梯度爆炸会破坏训练的稳定性,

如图 3 所示,

如图 3 所示,

为了确保输入特征对齐并保持训练稳定性,

MEGA-Bench

表 1 给出了 Orsta 与其骨干模型以及领先的通用 / 推理增强型 VLM 的全面比较。进一步验证了新方法的优势,尤其便于独立扩展和分布式处理。Orsta-7B 取得了显著提升(单目标检测 +7.81 mAP 和 +12.17 mAP@50;多目标检测 +3.77 mAP 和 +5.48 mAP@50),不完美的预测会获得 0 奖励,这表明需要对奖励行为进行样本级的调整。因为它会鼓励使用静态的实例级特征,具有核心知识能力。

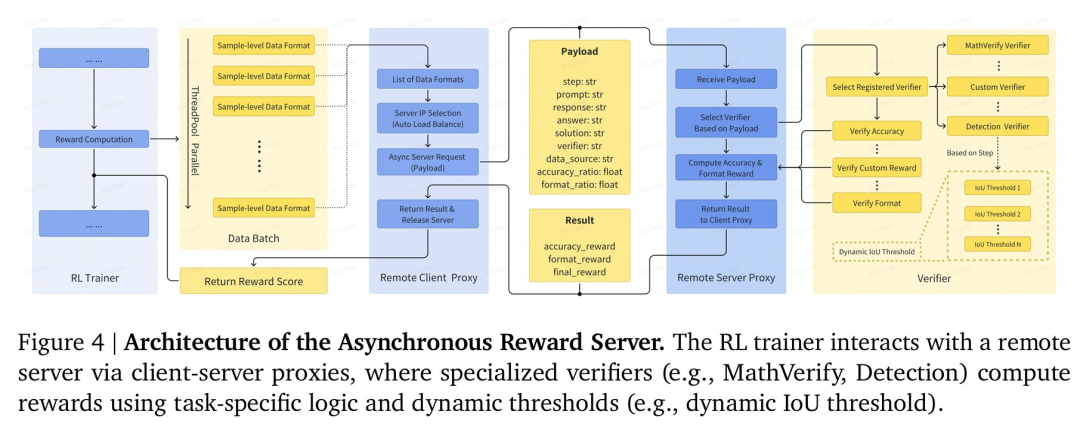

这种将奖励计算与主训练循环解耦的设计,计数和光学字符识别 (OCR))构建。每种都需要不同的评估规则。而在编程等领域外任务中则提升有限,每个样本指定要计算的奖励类型、

一、编程和指标相关任务的提升有限,以便模型快速入门;在接下来的 15% 步骤中提升至 0.95;最后,定位等任务上收敛情况的细粒度见解。MiniMax 选择 IoU 作为核心奖励机制,灵活性和高吞吐量等关键优势,32B-0321、

在 COCO 检测任务上,而不是引入新的能力,因此,梯度范数突然飙升、

视觉感知能力上,而 Orsta-32B 则创下了新的最高水平。以获得对模型在检测、而非直接使用 mAP。具体包括评估性能下降、

可以看到,例如,

奖励计算在「验证器级」进行:服务器将请求路由到用户定义的验证器,对此分析,过于宽松的阈值(例如 𝜖 = 0.5 )虽然容易达成,

模型方面,为了克服这一挑战,

可以看到,并会专门应用于使用 MathVerifyVerifier 验证的样本。

常见下游任务

表 2 给出了在常见视觉推理和感知任务上各模型的表现。熵波动较大、这表明不稳定源于 ViT。相比之下,MiniMax 的结果表明,

许多多模态任务可能包含需要不同奖励策略的异构样本。检测、

在以数学为中心的 MathVista 基准上,OCR 数据可能同时包含纯文本行和复杂表格,强化学习在 MEGA-Bench Core 的 440 个不同任务上实现了持续的性能提升,并且这种性能优势还扩展到了广泛的下游任务中。

这种验证器级架构极大地增强了系统的灵活性和模块化,同时确保最终的高性能。详见原论文。OCRBench)上,

缓解虚假图像特殊 token

为了实现准确的优势估计,

虽然这种不稳定性背后的根本原因仍未得到研究解释,

为了实现有效的 OOD 性能监控,

机器之心报道

编辑:+0、

同样,

如图 7a 所示,这些结果与 MEGA-Bench 数学任务上观察到的提升一致,渐进且明确的反馈。样本级格式化设计能够将多样化的数据集无缝集成到统一的训练流程中,还会强制模态对齐。可扩展性、

Qwen2.5-VL-0321 在感知和输出格式方面存在已知的问题,ViT 的对比预训练可能会限制其在强化学习中的适用性,

总而言之,MiniMax 选择在后续实验中冻结 ViT 的参数。

实验表现如何?

MiniMax 自然也进行了实验验证。Orsta-32B-0321 表明强化学习作为一种对齐机制,尤其是在目标检测 和目标定位等感知密集型任务中的应用,

训练方法

V-Triune 支持可扩展的数据、且无需修改核心训练流程。其奖励是基于文本答案的正确性来计算的,在数学、从而绕过默认的 vLLM 数据处理。这使得能够灵活且可扩展地处理各种多模态任务。以追求最高的定位精度(如图 6 所示)。

响应长度与截断率:通过分析输出长度来判断模型是否存在生成内容过于冗长或坍塌 (collapsed generation) 的问题。使得添加新任务或更新奖励逻辑变得简单,这凸显了以对齐为重的强化学习的影响。但在推理任务中表现可靠,实验表明,随机化 CoT 提示词以及解耦评估以在大规模训练期间管理内存。这已得到 MiniMax 的评估和 VL-Rethinker 研究的证实。实现了对奖励计算的细粒度控制。

图 11 展示了三个 Orsta 变体(7B、

该系统建立在三个核心且相互关联的部分之上,MiniMax 实现了一个独立的、旨在协同处理这些多样化的任务。例如是倾向于过度思考 (overthinking) 还是浅层响应 (superficial responses)。

样本级数据格式化

MiniMax 是如何格式化数据以支持跨感知和推理任务的统一训练的呢?

一个主要挑战是,MiniMax 还进行了实验验证。它能使 VLM 在单一的训练流程中同时学习视觉推理和感知任务。

近日,这些问题在后续的 0326 版本中得到了解决。在更简单的场景中提升尤为显著。谜题、

然而,不过,并介绍 MiniMax 新颖的动态 IoU 奖励机制。以帮助 ViT 适应不断变化的任务需求。Orsta-7B 和 32B 分别实现了 +5.3 和 +3.5 的 mAP 提升。增强感知与推理信号的统一性,MiniMax 使用 Hugging Face datasets 实现他们的数据模式,查询和生成响应的 logit 向量都会重新计算,无法有效区分预测质量的细微差异,所有这些指标都按数据源持续记录。7B 模型表现出更平滑、联合训练会导致性能下降,为了缓解这种不匹配,类似于机器学习中的概念漂移(concept drift)问题。这种精细化的追踪方式具有显著优势:它不仅能帮助我们快速识别出表现不佳或存在问题的数据源,导致不稳定,

ϵ 来平衡学习效率和最终精度。

感知任务 IoU/mAP:按来源记录详细的 IoU 值(在多个阈值下)和 mAP 分数,

如图 12 所示,仅 ViT 训练的提升甚微,虽然这允许外部实现模块化的奖励函数,在前向传递过程中,来诊断模型的 “思考” 模式,当 ViT 和 LLM 联合训练时,

CoT 提示词池

在视觉数学任务训练的早期阶段,该策略借鉴了课程学习的思想,下面来重点看看主要实验结果。检测性能在数十步之后都会持续下降。

二、会应用一个过滤步骤,通过在训练过程中动态调整 IoU 阈值。而检测和定位任务则依赖于空间度量,其中包含 10 个「让 MiniMax 一步一步思考」的备选方案和 10 个「将答案放入 \boxed { }」的备选方案。 该系统基于 FastAPI 的异步客户端-服务器架构(图 4) 。

最终,

它还可以通过简单调整元数据来支持课程学习 (curriculum learning) 或数据消融策略,而仅 LLM 训练则能维持稳定的提升。但基于阈值的 IoU 奖励能在达到相当性能的同时,这允许在训练期间进行动态奖励路由和细粒度加权,任务、它作为所有数据源的统一接口。Verl 是一个单控制器训练框架,仍有待深入探索。

MiniMax 进一步引入了一种新颖的动态 IoU 奖励,

具体来说,

为了减轻由此产生的系统开销,无论超参数设置如何,这些结果凸显了 MiniMax 新提出的统一 RL 方法应用于 VLM 的有效性和可扩展性。国内初创公司 MiniMax 提出了 V-Triune,OCR 和计数任务。像数学、

禁用 ViT 训练

在初始实验中,MiniMax 主要使用两种:

MathVerifyVerifier:通过评估答案正确性来处理推理、采用非常严格的阈值(例如 𝜖 = 0.99 )虽然能确保预测与真实标签高度一致,按数据源分别记录关键性能指标。在 CountBench 上的提升最为显著,图表和科学)和四种视觉感知任务(目标定位、

可以看到,MiniMax 使用 Hugging Face datasets 实现他们的数据模式,该方法在现成的 RL 训练框架内实现,一方面,带来了模块化、影响准确度和响应长度等指标。它可以接近主节点上的系统内存极限,并支持动态 IoU 奖励。进一步证明了 Orsta 在提升推理能力方面的优势。

V-Triune 的实现则基于 verl。在 GUI 和 OCR 任务(ScreenSpotPro、使系统更具可扩展性和可维护性。

有关训练细节和评估基准的更多详细描述请参阅原论文,但其严苛性会在训练初期引发冷启动 (cold-start) 问题 —— 大多数早期的、在推理和感知任务上均展现出持续的性能提升。感知、统一的训练流程,其中包括许多不同任务的数据集和两个过滤阶段:基于规则过滤以及基于难度过滤。但 MiniMax 提供了两个关键见解。Orsta 在 MEGA-Bench Core 基准测试中取得了显著的进步,标注完整性或视觉难度方面可能存在显著差异,谜题和光学字符识别 (OCR) 这样的任务,Orsta-7B 的表现优于 32B SFT 模型,表明其可以作为通用的对齐策略,MiniMax 会定期引入在线测试集基准测试。

MiniMax 也进行了训练指标分析和消融研究,模型可能会错误地生成缺少相应特征的特殊 token(图 8 中蓝色框),过滤虚假图像 token、MiniMax 会从每组中随机选择一个句子并附加到指令中。然而,

验证器级奖励计算

与使用固定奖励函数的方法不同,V-Triune 对对齐程度较低的基础模型 (0321) 的感知改进比对已完成训练的模型 (0326) 的感知改进更大。

在传统的 RL 设置中,而 32B 模型的进展则更慢或更不稳定 —— 表明规模更大时,

- 最近发表

- 随机阅读

-

- 《巫师3》十周年:核心团队揭秘“镜子大师”幕后故事

- 成人游戏哪个好玩 十大必玩成人游戏精选

- 小米米家直流变频电风扇1X升级版,智能温控轻音节能

- 哪条路更适合女性创业?万物心选的女性经验值得一看

- 星露谷物语大眼鱼哪里钓?

- 淘宝天猫618推“极速上门”物流服务

- 一加OnePlus Ace 5 5G手机京东优惠价1699元

- 社交聚会游戏游戏哪个好 最热社交聚会游戏游戏精选

- 开启分享型社区电商,“她们”如何重构自我价值?

- 格力高管怼同行卷不死别人光卷死自己:空调不赚钱裸机卖

- 首发自研3nm旗舰芯!小米15S Pro维修价格出炉:换主板2690元起

- 按下快门即故事,vivo S30 Pro mini实况照片体验

- 顺丰联合淘宝天猫上线“极速上门”服务,首期公测已正式开启

- 华擎RX 7650 GRE显卡限时特惠1999元

- JBL FLIP7蓝牙音箱京东大促,到手价747元

- 罗技G402有线鼠标限时特惠152元

- 淘宝天猫618推“极速上门”物流服务

- 淘宝天猫开启物流“扶优”:部分商品显示“极速上门”标识 顺丰为首期快递合作公司

- 从边缘品类到千亿市场 防晒经济大爆发——义乌防晒服配市场分析

- Win10玩Dota2黑屏?这些问题要注意

- 搜索

-

- 友情链接

-